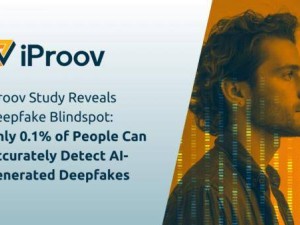

近期,深度伪造技术(deepfake)的飞速发展引发了公众对虚假信息、诈骗及身份盗用的广泛忧虑。一项最新研究成果揭示了一个令人担忧的现象:大众对于AI工具的辨识能力普遍较低,难以有效区分深度伪造的内容。

iProov公司的一项研究揭示了这一严峻现实。该研究在英国和美国招募了2000名参与者,向他们展示了一系列真实与AI生成的图像和视频。结果惊人:仅有两名参与者,即0.1%的比例,能够准确无误地区分真实内容与深度伪造内容。

研究进一步指出,老年群体在面对人工智能生成的虚假内容时尤为脆弱。在55至64岁的人群中,约30%的人从未听说过深度伪造;而在65岁以上的群体中,这一比例更是高达39%。尽管年轻参与者对自己的辨识能力更为自信,但在实际测试中,他们的表现并未优于其他年龄段。

值得注意的是,深度伪造视频相较于图像更难被识别。参与者识别假视频的可能性比识别假图像低了36个百分点。

更令人担忧的是,即便人们怀疑某个内容是深度伪造,大多数人也不会采取任何行动。仅有20%的受访者表示,若在网上遇到疑似深度伪造内容,他们会选择举报。

随着深度伪造技术日益精进,iProov公司强调,仅凭人类感知已难以可靠识别这类内容。因此,需要采用具备活体检测功能的生物识别安全解决方案,以应对愈发逼真的深度伪造威胁。