微软近日在Hugging Face平台上开源了一款名为Phi-4的小型语言模型,该模型的发布日期为2024年12月12日,但直到今年1月8日才正式向公众开放下载、微调和部署权限。这一消息引起了众多开发者和AI爱好者的广泛关注。

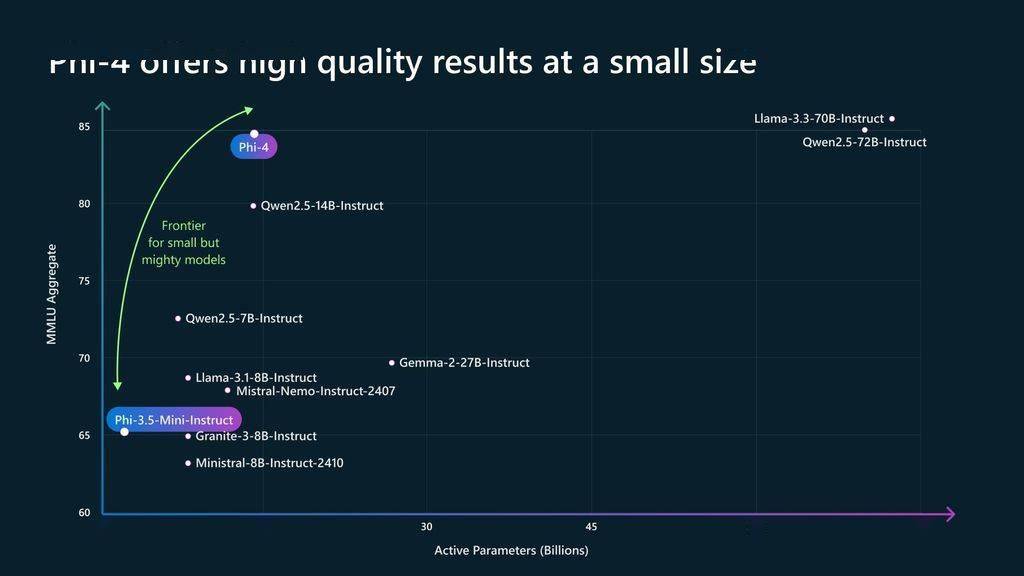

Phi-4虽然参数量仅为140亿,但在多个基准测试中的表现却令人瞩目。据悉,这款模型在测试中超越了参数量更大的Llama 3.3 70B(其参数量几乎是Phi-4的五倍)和OpenAI的GPT-4o Mini,显示出其强大的处理能力和高效性。

更令人惊讶的是,Phi-4在数学竞赛问题中的表现也异常出色,甚至超过了Gemini 1.5 Pro和OpenAI的GPT-4o。这一结果不仅证明了Phi-4在处理复杂数学问题上的能力,也进一步彰显了微软在AI技术研发方面的深厚实力。

Phi-4之所以能够实现如此出色的性能,主要得益于微软在训练过程中精选了高质量的数据集。这些数据集为模型的训练提供了坚实的基础,使其能够在各种场景下表现出色。然而,目前Phi-4的推理部分尚未进行优化,这意味着开发者在未来还有进一步提升其性能的空间。

对于个人用户和开发者而言,Phi-4的开源无疑是一个好消息。他们可以在自己的个人电脑和笔记本电脑上下载并部署这款模型,进行进一步的微调和优化。随着技术的不断进步和开发者们的持续努力,相信Phi-4未来将在更多领域展现出其强大的应用价值。